多动症是注意缺陷与多动障碍 ,指发生于儿童时期,与同龄儿童相比,以明显注意集中困难、注意持续时间短暂、活动过度或冲动为主要特征的一组综合征。多动症是在儿童中较为常见的一种障碍,其患病率一般报道为3%-5%,男女比例为4-9:1。

与人工智能(AI)的相互作用将成为我们生活中越来越常见的方面。德国慕尼黑工业大学(TUM)的一个研究团队现在完成了一项关于人工智能如何帮助治疗精神疾病的研究。但是,研究团队指出,这项技术的道德问题目前仍然找不到解答。后续会与政府、专业协会和研究人员积极的寻找解答。

目前已经存在著许多使用人工智能改善心理健康的研发,比如,机器人娃娃教导自闭症儿童并让患儿有更好的交流,计算机生成的头像可以帮助患者应对幻觉,提供虚拟聊天并能支持抑郁症等,这些应用涉及个体和人工代理之间的相互作用,从而产生全新的动态。

人工智能在心理治疗中的应用并不是创新之举,早在20世纪60年代,第一个聊天机器人创造了心理治疗的错觉。但是实际上,这只不过是一个噱头。如今,凭借著先进的算法和更高的计算能力,机器人可以实现更多功能。研究团队透过对心理健康的具体AI应用进行了第一次系统调查,并就相关的机遇和挑战得出了结论。这些新应用背后的算法已经累积大量数据,也过了无数的运算,让机器人可以产生真正的治疗陈述。

治疗机器人为更多人提供治疗

治疗机器人具有非常大的潜力,机器人可以让更多人接受治疗,因为机器人不限于特定的时间或地点,此外,也发现有一些患者与人工智能(AI)进行交沟通比与人类沟通还要更来得容易,但使用机器人进行治疗也存在著风险,因为人工智能方法不能用作人类医生治疗的廉价替代品。

虽然体现人工智能已经进入临床试验阶段,但医学协会关于要如何处理人工智能的医疗行为问题的建议仍然很少,但是,如果要使用人工智能在治疗方面,并确保道德之议题及医生权益的话,医学界则需紧急采取行动处理机器人与医疗行为之间所衍生的道德问题。研究团队也指出,往后,年轻的医生也应该在医学院时就接触治疗机器人的问题。

治疗机器人的道德规则仍然缺乏

目前,各界正在加大力度制定治疗机器人的指南,包括欧盟于今年四月初公布的值得信赖的人工智能(AI)道德准则,而慕尼黑的研究团队也认为,目前迫切需要在专业领域规范治疗机器人(AI)的使用。

值得信赖的AI的七项道德准则

1、人类机构监督:AI系统应该支援人类机构和基本权力来协助社会,而不是减少或限制或误导人类。

2、稳健与安全性:值得信赖的AI的演算法必须安全、可靠且强大,以便系统在任何时期都能处理错误或者不一致。

3、隐私与数据控管:人类应该对自己的数据有完全的控制权,数据不应该被反过来被用于加诸伤害或歧视。

4、透明度:确保AI系统的可溯性。

5、多元化、无歧视和公平性:AI系统应该考虑人类整体的能力、技能及要求,并确保可访问性。

6、社会和环境福祉:AI系统应该增强可持续性和生态责任。

7、问责制度:建立相关机制,确保AI系统及结果范围及其责任归属。

在道德的准则上,我们需要适当的批准治疗性的人工智能(AI)的应用,比如,治疗性人工智能可以识别患者是否有自杀念头,那么人工智能就必须遵循明确的警告协议,就像治疗师一样,如果患者出现严重问题,则紧急的告知患者的医师。

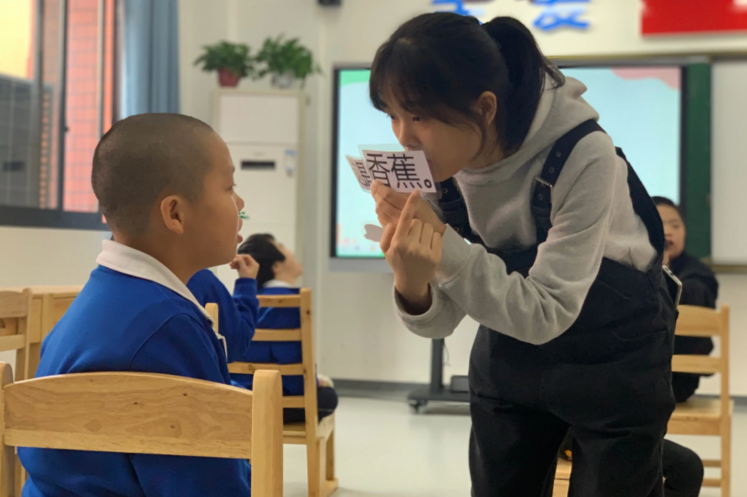

研究团队亦说明,目前需要深入研究具体的人工智能对社会产生的影响,在目前的医学及科学研究上几乎没有关于人类因接触治疗性的人工智能而受到影响的信息,比如,通过与机器人接触,患有自闭症谱系障碍的孩子可能只学习如何更好的与机器人进行互动,而不是与人进行互动。

写在最后

科技的进步日新月异,也因此如果治疗机器人一旦诞生并运用在现实生活中,对孩子来说,我们首先要担心的是自闭症孩子是否会对治疗机器人产生依赖,原本希望透过治疗机器人帮助自闭症的孩子融入社会,却因为对机器人的依赖性太强,反而离融入社会越来越远。

其次是自闭症孩子与父母之间的相互关系,会不会因为治疗机器人介入了与孩子之间的互定,反而亲子之间的关系更为疏远?因为有了治疗机器人,孩子的一举一动都可以被机器人记录下来,那么父母还会主动的记录孩子的康复过程吗?父母还会主动寻求治疗方法吗?治疗性的人工智能的道德问题,一直是备受争议的,在种种争议中,您对治疗性的机器人看法又是什么呢?